La loi de Moore ou Quo non ascendet ?

Par Henri T.

Quo non ascendet ? (Jusqu’où ne montera-t-il pas ?) est une adaptation de la devise de Fouquet, ministre des finances de Louis XVI que son orgueil perdit puisqu’il finit en prison.

Un peu d’histoire

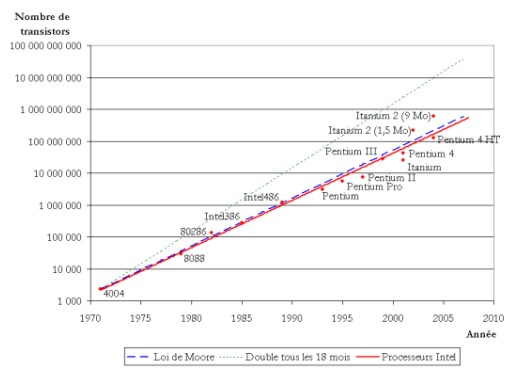

La loi de Moore est une loi empirique. Elle est le constat formulé en 1965 par Gordon Moore, co-fondateur de la société Intel.

Gordon Moore

(1929 – 2023))

Elle peut s’énoncer ainsi :

« Le nombre de transistors présents sur une puce de circuit intégré double approximativement tous les deux ans, ce qui entraîne une augmentation exponentielle de la puissance de calcul des processeurs »

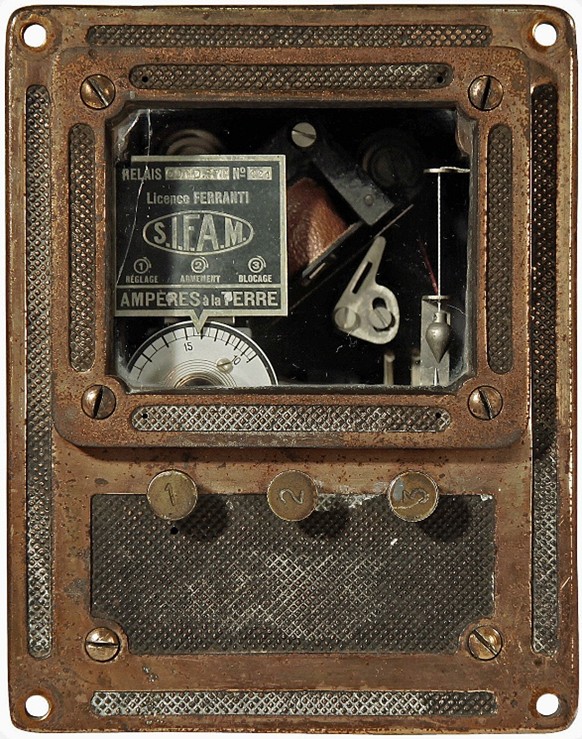

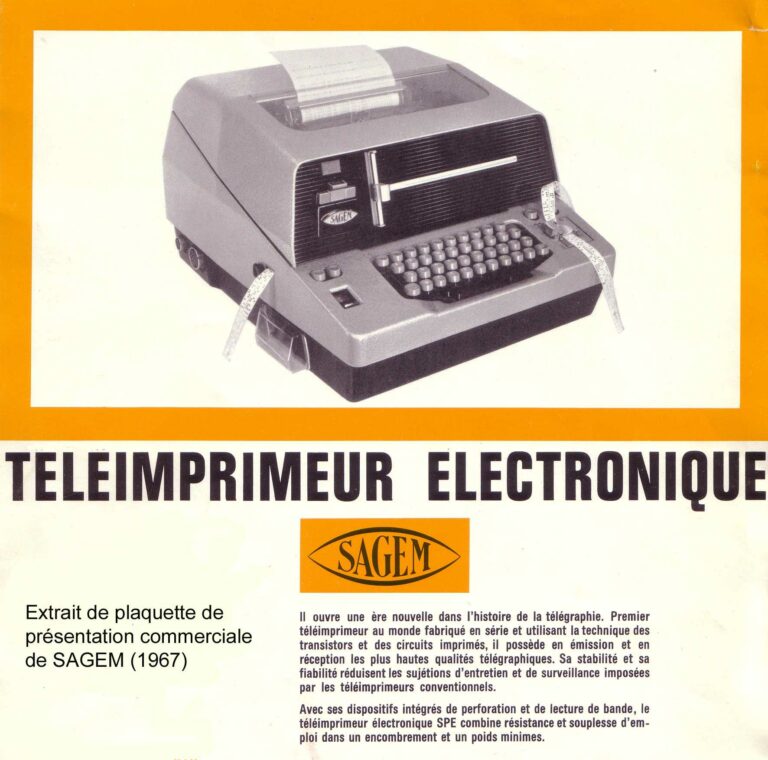

Pour mémoire, le transistor est né en 1947, il s’est invité vers 1956 dans des équipements utilisés à EDF. C’était un transistor PNP au germanium OC71 et il est encore en vente de nos jours sur internet !!

Puis, sont apparus, vers 1959, le circuit intégré aussi appelé puce électronique et, vers 1971, le microprocesseur.

Puis, sont apparus, vers 1959, le circuit intégré aussi appelé puce électronique et, vers 1971, le microprocesseur.

L’Intel 4004 comptait 2300 transistors, calculait sur 4 bits et était cadencé à 740 kHz. (Une prouesse pour l’époque).

En 1980, l’Intel 8088 avait une architecture à 16 bits cadencée à 5 MHz. Il a été utilisé dans les premiers PC d’IBM.

Dès 2004, le Pentium 4 comportait environ 10 millions de transistors était cadencé à 800 MHz. C’est le début d’une rupture qui va révolutionner l’informatique, les télécommunications, le multimédia, et également tous les équipements qui participent à la conduite du réseau électrique.

Ainsi les Mini 6 puis leurs successeurs les DPS6, largement utilisés dans les services EDF, étaient équipés d’un processeur 16 bits.

En 1989, le processeur Intel 80486 codait sur 32 bits avec 1 200 000 transistors et dés 2006 le codage s’effectuait en 64 bits.

Ce nombre était associé à une finesse de gravure de 65 nm (les transistors sont gravés sur une plaquette de silicium par un procédé de photolithographie).

L’évolution va d’ailleurs se poursuivre, en particulier grâce aux progrès dans la technique de gravure mais surtout dans la maitrise du refroidissement et de la diminution de la consommation énergétique.

Si, vers 2015, les puces étaient gravées à 15 nm, elles le sont actuellement à 7 nm et il est envisagé vers 2026 une gravure à 2 nm permettant un fonctionnement avec une consommation énergétique bien plus réduite.

Le dernier microprocesseur d’Intel (Core i9-11900K) a été lancé en 2021. Il s’agit d’une unité de calcul de 64 bits, cadencée à 5,3 GHz et intégrant 16 milliards de transistors.

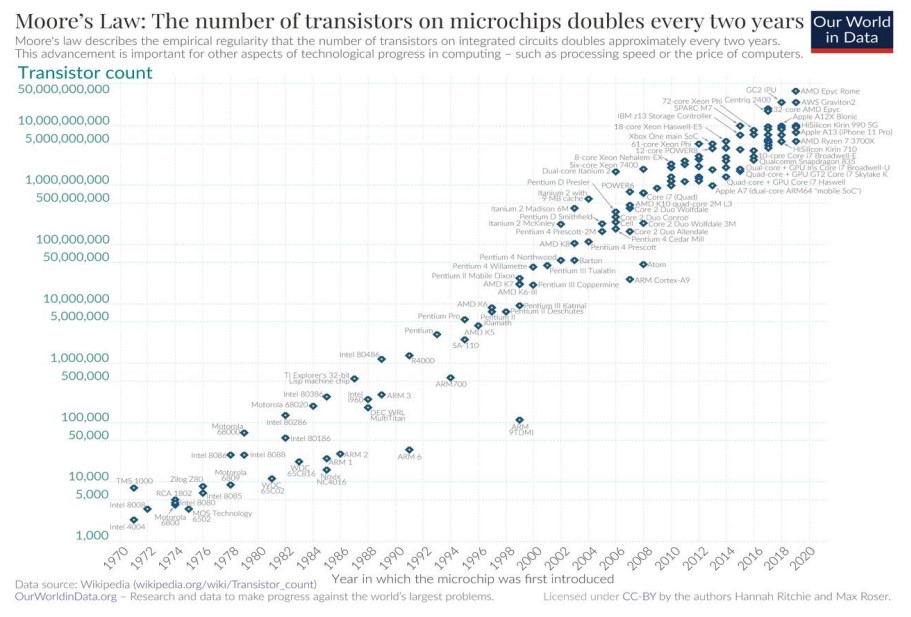

Ci-dessous, un nuage de points montrant l’évolution du nombre de transistors dans les puces depuis l’Intel 4004 jusqu’à nos jours.

La loi de Moore n’est pas isolée

Il existe aussi d’autres lois empiriques moins connues :

*La loi de Gates : La vitesse de réalisation et d’exécution des logiciels est divisée par deux tous les dix-huit mois.

*La loi de Parkinson : Si le besoin en mémoire des systèmes double tous les 2 ans, heureusement les mémoires se développent quasi à la même vitesse que les puissances de calcul.

*La loi du Big Data : le nombre de données (data) enregistrées double tous les 2 ans., (Cédric Villani)

*Et une constatation : Grace à la fibre optique, les « tuyaux », disons la bande passante, grossissent trois fois plus vite que la capacité de calcul.

Et pour le futur ?

Depuis nombre d’années, la fin de la loi de Moore a été annoncée sans que les faits viennent le confirmer. L’experts actuels mettent en avant plusieurs types de limites :

• Physiques : À mesure que les transistors deviennent de plus en plus petits, les défis liés à la dissipation thermique et aux effets quantiques augmentent considérablement.

• Economiques : Les coûts de développement et de fabrication des technologies de plus en plus miniaturisées sont devenus extrêmement élevés, ce qui limite la rentabilité de nouveaux développements industriels.

• Technologiques : Il devient de plus en plus difficile de continuer à augmenter la densité des transistors sans rencontrer des problèmes significatifs de performance et de fiabilité.

Lesdits experts s’accordent à dire que la loi de Moore est en train de ralentir et pourrait atteindre ses limites d’ici 2030.

La course à la performance s’orienterait vers de nouvelles pistes telles que architectures multicœurs ou technologies de calcul alternatives (telle que l’informatique quantique).

Revenons à nos moutons

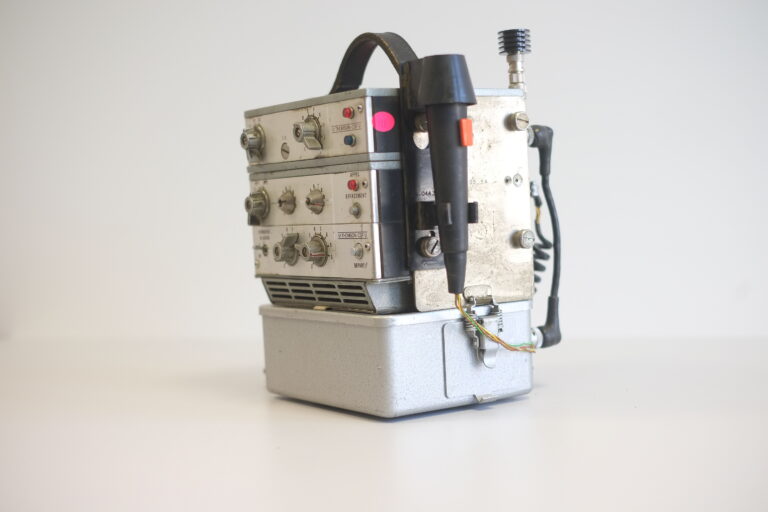

En ce qui concerne la conduite du réseau électrique, toutes ces évolutions ont permis la réalisation et la mise en exploitation de matériels, de logiciels et de voies de transmission performants pour assurer la conduite, la surveillance, la maintenance et la sécurité du réseau.

A titre d’exemple, pour Rte, ces évolutions technologiques ont permis d’apporter l’intelligence au plus prés du terrain pour pouvoir utiliser le matériel au plus près des limites. Elles ont aussi permis de traiter un nombre d’informations de plus en plus importants au niveau des points de conduite et de commande et de fournir des aides à la conduite pour la surveillance et la prise de décision.

Parmi tous les paramètres influents sur la puissance de calcul nécessaire on pourrait prendre l’accroissement de la réactivité, les aides à la conduite de réseaux de plus en plus grands celles pour traiter des moyens de production intermittents, la sensibilité des clients aux perturbations, mais pour rester simple nous ne prendrons que le nombre de téléinformations :

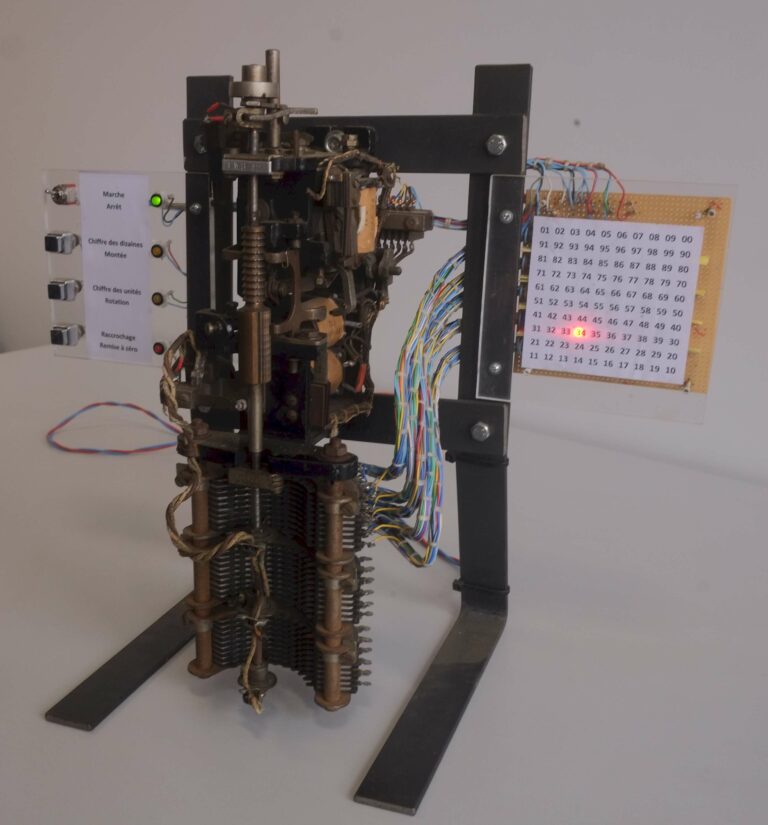

Vers 1970, la conduite du réseau électrique THT et HT français nécessitait 5 000 télémesures, 30 000 télésignalisations traitées par une centaine de PCG et 9 dispatchings.

Vers 1990, les besoins étaient de 10 000 télémesures, 40 000 télésignalisations, traitées par Sensiblement moins que 150 points de conduite (PCG et 8 dispatchings)

Actuellement les dimensionnements pour les systèmes à venir laissent à penser qu’il y aura un facteur d’environ 10 par rapport à 1990.

La vérification de la loi de Moore a heureusement permis de suivre cette explosion des besoins. Et comme nous avons fait référence à Fouquet pour débuter nous terminerons en citant Laeticia Bonaparte : « pourvu que ça dure »